合作机构:阿里云 / 腾讯云 / 亚马逊云 / DreamHost / NameSilo / INWX / GODADDY / 百度统计

资讯热度排行榜

- 92221大模型×文本水印:清华、港

- 91162一文读懂如何基于 GenA

- 908632024 年,3 项技术将

- 90544AI在工业物联网(IIoT

- 90465利用人工智能增强网络安全防

- 90456GPT-4准确率最高飙升6

- 90447人工智能和机器学习在物联网

- 90268一句话让小姐姐为我换了N套

- 90169AI时代来了,专业摄影师会

- 9015102024年人工智能与数字孪

推荐阅读

- 01-241技术趋势:2024年的热点是什么

- 01-252网络安全在自动驾驶汽车中的作用

- 01-253OpenAI创始人想打造全球芯片

- 01-264强化学习和世界模型中的因果推断

- 01-265Mamba论文为什么没被ICLR

- 01-296让知识图谱成为大模型的伴侣

- 01-297从20亿数据中学习物理世界,基于

- 01-298谷歌云与Hugging Face

- 01-299人工智能和机器学习在物联网中的作

- 01-2910无需人工标注!LLM加持文本嵌入

大模型推理成本排行榜来了:贾扬清公司效率领跑

「大模型的 API 是个亏本买卖吗?」

随着大语言模型技术的逐渐实用化,越来越多的科技公司提出了大模型 API 供开发者们使用。但前有 OpenAI「每天烧掉 70 万美元」,我们也有理由怀疑以大模型为基础的业务到底能不能持续。

本周四,AI 创业公司 Martian 为我们仔细盘算了一下。

排行榜链接:https://leaderboard.withmartian.com/

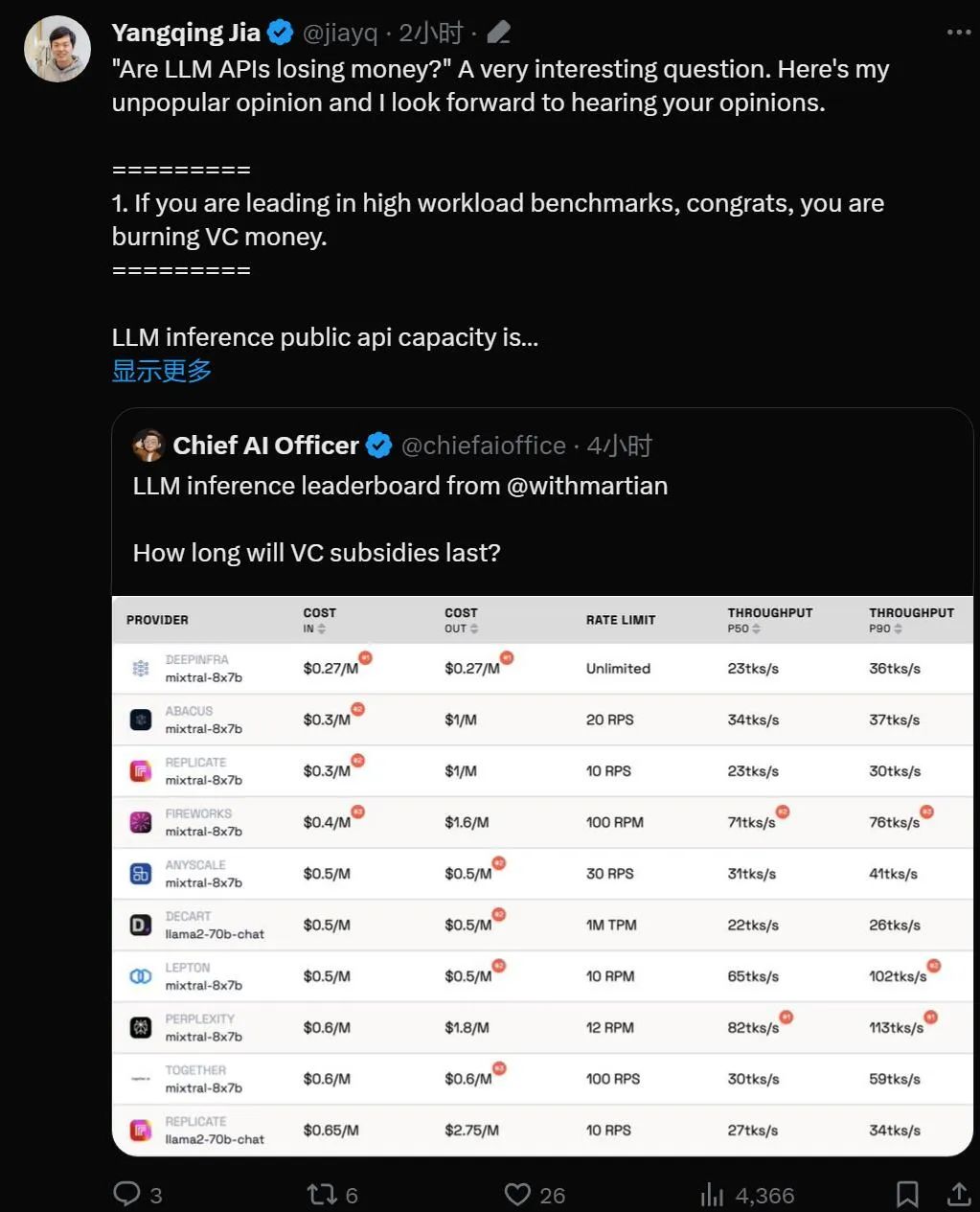

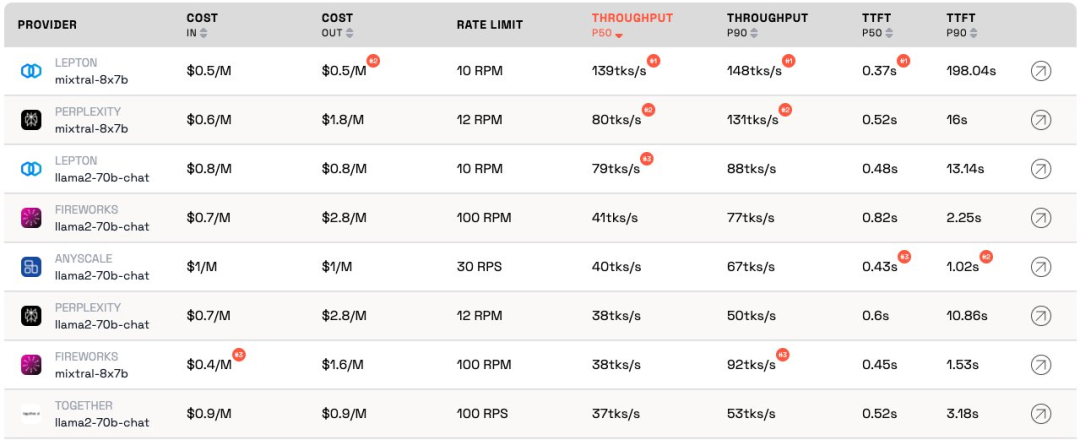

The LLM Inference Provider Leaderboard 是一个开源的大模型 API 推理产品排行榜。对于每个供应商的 Mixtral-8x7B 和 Llama-2-70B-Chat 公共端点,该榜单对成本、速率限制、吞吐量和 TTFT 的 P50 和 P90 进行了基准测试。

虽然互为竞争关系,但 Martian 发现各家公司提供的大模型服务之间存在大于 5 倍的成本差异,大于 6 倍的吞吐量,甚至还存在更大的速率限制差异。虽然在不同性能的大模型之间进行选择只是业务开展的一部分,但选择不同的 API 对于获得最佳性能显然至关重要。

在目前的榜单上可见,Anyscale 提供的服务对于 Llama-2-70B 的中等服务负载具有最佳的吞吐量。Together AI 对于 Llama-2-70B 和 Mixtral-8x7B 的大型服务负载具有最佳的 P50 和 P90 吞吐量。

此外,贾扬清的 LeptonAI 在短输入 + 长输出提示的小服务负载上能够提供最佳的吞吐量。130 tks/s 的 P50 是所有厂商提供的所有模型产品中可以观察到的最快吞吐量。

知名 AI 学者、Lepton AI 创始人贾扬清在排行榜放出后第一时间进行了点评,让我们看看他是如何说的。

贾扬清首先阐述了人工智能领域行业现状,然后肯定了基准测试的意义,最后指出 LeptonAI 将帮用户找到最好的 AI 基础策略。

1. 大模型 API 正在「烧钱」

如果模型在高工作负载基准测试中处于领先地位,那么恭喜,它正在「烧钱」。

LLM 推理公共 API 的容量就像是经营一家餐馆:有厨师,需要估算客流量。聘请厨师是要花钱的。延迟和吞吐量可以理解为「你为顾客做饭的速度有多快」。对于一个合理的生意,你需要有「合理」数量的厨师。换句话说,你希望拥有能够承载正常流量的容量,而不是在几秒钟内突然爆发的流量。流量激增意味着需要等待;反之,「厨师」则会无所事事。

在人工智能世界中,GPU 扮演着「厨师」的角色。基准负载是突发的。在低工作负载下,基准负载会混合到正常的流量中,并且测量结果可以准确表示服务在当前工作负载下的情况。

高服务负载场景则很有趣,因为会带来中断。基准测试每天 / 每周仅运行几次,因此不是人们应该期望的常规流量。想象一下,让 100 个人涌入当地的餐馆来检查厨师做菜的速度,结果会很不错。借用量子物理学的术语,这被称为「观察者效应」。干扰越强(即突发负载越大),其精度就越低。换句话说:如果您给某个服务突然提供高负载,并发现该服务响应速度非常快,那么您就知道该服务有相当多的闲置容量。作为投资者,看到这种情况,你应该质问:这种烧钱的方式负责任吗?

2. 模型最终会达到相似的表现

人工智能领域很喜欢竞争比赛,这的确很有趣。大家都会很快收敛到相同的解决方案,并且,由于 GPU 的原因,英伟达总是最终的赢家。这要归功于伟大的开源项目,vLLM 就是一个很好的例子。这意味着,作为提供商,如果您的模型性能比其他模型差很多,您可以通过查看开源解决方案并应用良好的工程来轻松赶上。

3.「作为客户,我不关心提供商的成本」

对于人工智能应用程序构建者来说,我们很幸运:总是有 API 提供商愿意「烧钱」。AI 行业正在烧钱来获得流量,下一步才是担心利润。

基准测试是一项乏味且容易出错的工作。无论好坏,通常都会发生成功者赞扬你而失败者指责你的情况。上一轮卷积神经网络基准测试就是如此。这不是一件容易的事,但基准测试将帮助我们在人工智能基础设施方面获得下一个 10 倍的收益。

基于人工智能框架和云基础设施,LeptonAI 将帮用户找到最好的 AI 基础策略。

-

TOP